最大限のインテリジェンス。最小限の計算資源。

ビジネスに最適化されたエンドツーエンドのカスタム AI

お客様のビジネス要件、ハードウェア、データに合わせた本格的なカスタムAIソリューションを提供します。当社独自の効率的なモデル開発プロセスは、デバイス対応のモデルアーキテクチャ探索に基づいており、レイテンシー、プライバシー、セキュリティといった重要な要件を満たすモデルを、オンデバイス、クラウド、またはハイブリッド環境で迅速に提供します。

特化型 AI で競争優位を築く

カスタマイズされた LFM により、スタートアップの成長を加速し、持続的な競争優位を実現します。スタートアッププログラムを通じて、選ばれた企業は、製品・エンジニアリングチームによる専門的なサポートとともに、最適なモデルの特化・展開を行うためのフルスタックにアクセスできます。

LFM を特化し、どこへでもデプロイ

開発者ツールとコミュニティを通じて、初心者から大規模システムを構築する専門家まで、誰もが高効率で強力な AI を構築・特化・デプロイできる環境を提供します。

成果を生む、効率的な AI。必要な場所で。

市場最高クラスの効率性を実現

LFM は、効率性、スピード、そして実運用を前提に設計されています。

ウェアラブル、ロボティクス、スマートフォン、ノートPC、自動車まで、GPU・CPU・NPU 上でシームレスに動作し、クラス最高水準のパフォーマンスを発揮します。

LFM2 ファミリーは、さまざまなモダリティとパラメータサイズに対応し、ユースケースに最適な AI を迅速にカスタマイズ可能です。

すべての人に、効率的なオンデバイス AI を。

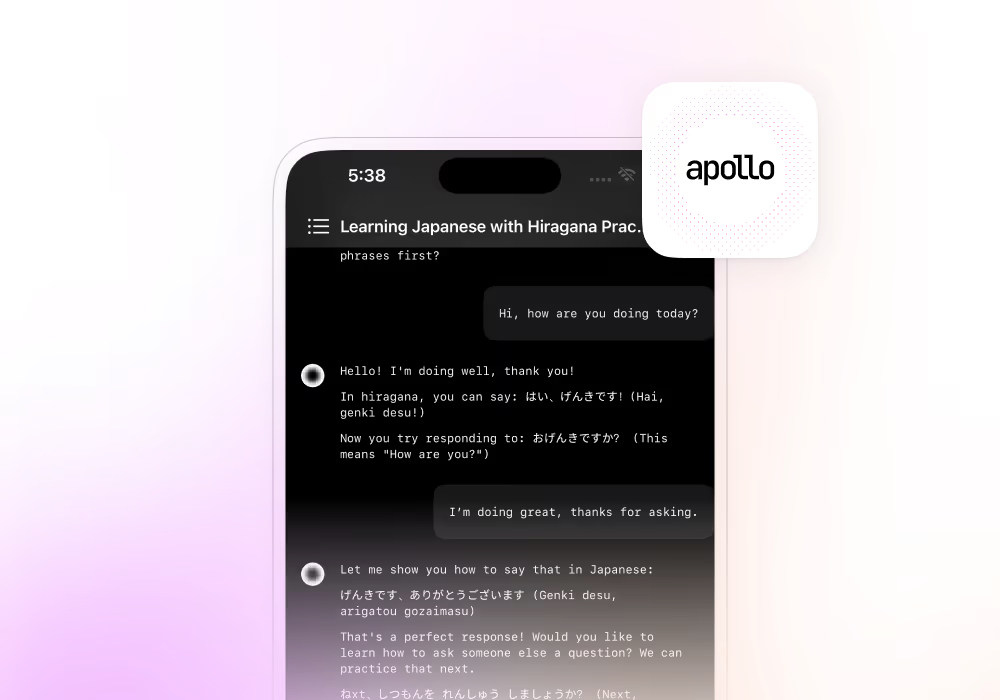

オンデバイスAIの構築・特化・デプロイを可能にする開発者向けプラットフォーム LEAP と、スマートフォン上で小規模言語モデルを手軽に試せる軽量アプリ Apollo により、初心者からエキスパートまで、誰もがオンデバイスAIを活用できます。

LiquidAI/LFM2-1.2B

LiquidAI/LFM2-Audio-1.5B

LiquidAI/LFM2-350M

LiquidAI/LFM2-VL-1.6B

LiquidAI/LFM2-700M

LiquidAI/LFM2-VL-450M

LiquidAI/LFM2-350M-ENJP-MT

LiquidAI/LFM2-1.2B-RAG

LiquidAI/LFM2-1.2B

LiquidAI/LFM2-350M

LiquidAI/LFM2-700M

LiquidAI/LFM2-1.2B

.svg)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)